Residualdiagnostik

Eine Reihe weiterer Annahmen betreffen die sogenannten Residuen des Regressionsmodells. Als Residuen werden die messbaren Abstände zwischen Beobachtungspunkt und der berechneten Regressionsgerade bezeichnet. Diese Bestandteile der Regressionsdiagnostik werden daher auch Residualdiagnostik genannt.

Mittelwert der Residuen von etwa 0

Laut einer dieser Annahmen sollen die Residuen einen Mittelwert von etwa 0 aufweisen. Abweichungen von der Regressionsgeraden nach unten oder oben werden stets auftreten. Wichtig ist aber mit Blick auf die Annahme, dass sich diese „Ausschläge“ ausgleichen. Ist diese Voraussetzung nicht erfüllt, so besteht eine hohe Wahrscheinlichkeit, dass eine wesentliche unabhängige Variable nicht berücksichtigt wurde. Eine Überprüfung der Annahme erfolgt über die Ausgabe deskriptiver Statistiken der Residuen.

Homoskedastizität der Residuen

Eine weitere Modellvoraussetzung ist die sogenannte Homoskedastizität, die die gleiche Streuung der Residuen bezeichnet. Ist dies nicht der Fall, liegt eine heteroskedastische Streuung in den Residuen vor. Verzerrte Standardfehler können die Folge sein. Homoskedastizität lässt sich über eine theoretisch geleitete Spezifikation des Modells sicherstellen, bei der die relevanten Variablen integriert werden.

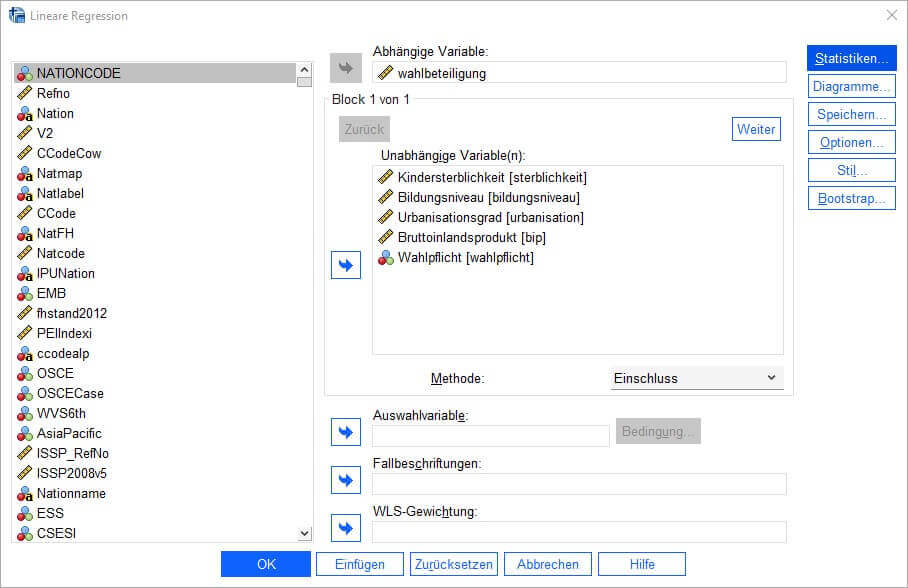

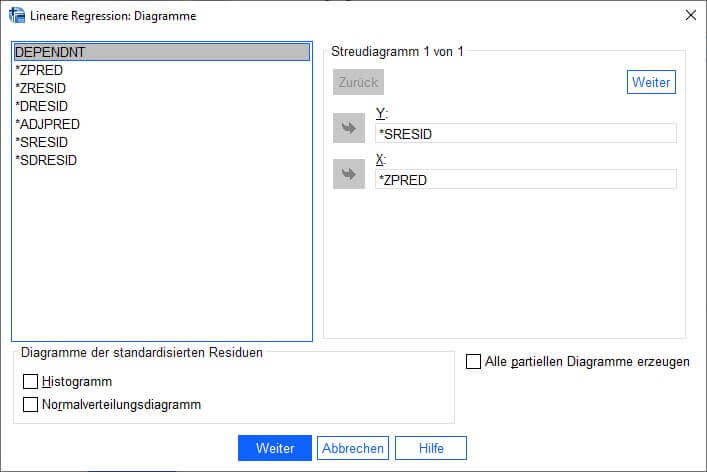

Eine Überprüfung der Annahme kann ebenfalls über ein Streudiagramm erfolgen. Dabei werden auf der X-Achse die standardisierten vorhergesagten Werte und auf der Y-Achse die studentisierten Residuen abgetragen. In der grafischen Darstellung sollte schliesslich deutlich werden, dass die Residuen eine gleichmässige Streuung um die X-Achse aufweisen. Würde eine trichterförmige Verteilung der Datenpunkte auftreten, müsste dagegen Heteroskedastizität angenommen werden. In SPSS lässt sich ein solches Diagramm ebenfalls über die Schaltfläche „Diagramme“ im Menü „Lineare Regression“ erstellen. Für die Y-Achse wird „*SRESID“, für die X-Achse „ZPRED“ ausgewählt und anschliessend mit „Weiter“ bestätigt. Im Ergebnis erhält man das nachfolgende Diagramm:

Über die Syntax kann das Streudiagramm zur Diagnose der Homoskedastizität über die zusätzliche Zeile „/SCATTERPLOT=(*SRESID ,*ZPRED)“ unter dem Befehl der linearen Regression angefordert werden:

REGRESSION

/MISSING LISTWISE

/STATISTICS COEFF OUTS R ANOVA

/CRITERIA=PIN(.05) POUT(.10)

/NOORIGIN

/DEPENDENT wahlbeteiligung

/METHOD=ENTER sterblichkeit bildungsniveau urbanisation bip wahlpflicht

/SCATTERPLOT=(*SRESID ,*ZPRED).

Zudem besteht die Möglichkeit eines Nachweises mit einem statistischen Test, z. B. dem Breusch-Pagan-Test, der über das Menü via „Analysieren“, „Allgemeines lineares Modell“ und schliesslich „Univariat“ zu erreichen ist. Nach Festlegung der Modellvariablen kann der Test unter der Schaltfläche „Optionen“ aktiviert werden. Ist der Signifikanzwert > 0,05, so kann die Annahme von Homoskedastizität bestätigt werden.

Normalverteilung der Residuen

Analog zu einer gleichen Streuung der Residuen sollten diese ausserdem einer Normalverteilung für jeden Wert der X-Variablen folgen. Die Normalverteilung der Residuen dürfte zu den bekanntesten und am häufigsten überprüften Modellannahmen gehören. Regressionsmodelle sind vor allem bei kleinen Fallzahlen für eine Verletzung der Annahme anfällig, sodass insbesondere in diesem Fall eine Überprüfung angezeigt ist. Hier kann ebenfalls eine grafische Überprüfung erfolgen, indem Normal-Probability-Plots der Stichprobenresiduen angefertigt werden.

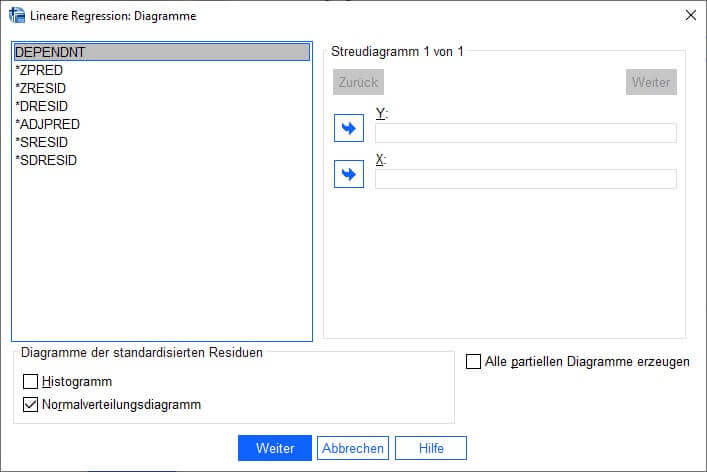

Auch dieses Diagramm ist über die Schaltfläche „Diagramme“ im Dialogfeld „Lineare Regression“ zu erreichen. Hier wird nun das Kontrollkästchen „Normalverteilungsdiagramm“ aktiviert (alternativ kann die Normalverteilung der Residuen auch mithilfe eines Histogramms im selben Dialogfeld geprüft werden). Die Normalverteilung der Residuen kann nun anhand der diagonalen Linie überprüft werden, die als Referenzmarke dient. Wenn die Datenpunkte eng auf oder um die Linie liegen, kann eine Normalverteilung der Residuen geschlussfolgert werden.

In der SPSS-Syntax wird hierfür analog zu den o. g. Befehlen erneut eine Befehlszeile „/RESIDUALS NORMPROB(ZRESID)“ hinzugefügt:

REGRESSION

/MISSING LISTWISE

/STATISTICS COEFF OUTS R ANOVA

/CRITERIA=PIN(.05) POUT(.10)

/NOORIGIN

/DEPENDENT wahlbeteiligung

/METHOD=ENTER sterblichkeit bildungsniveau urbanisation bip wahlpflicht

/RESIDUALS NORMPROB(ZRESID).

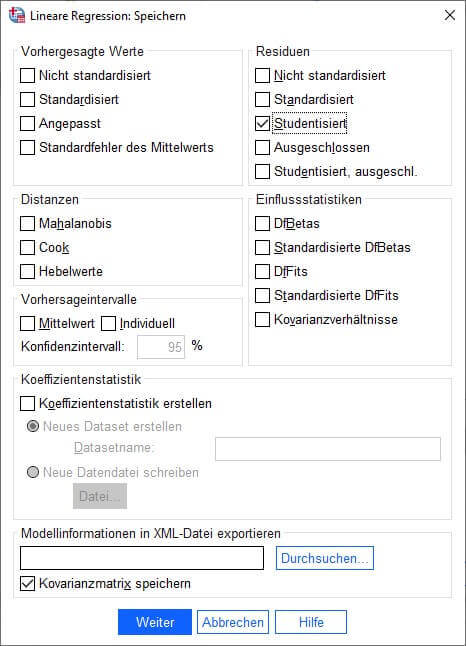

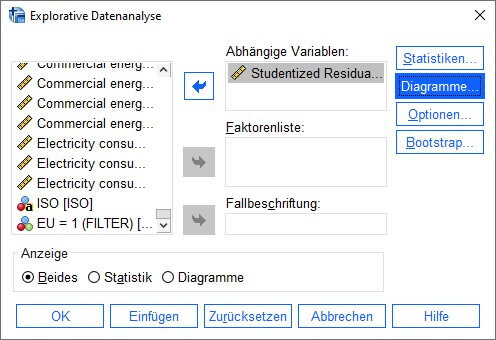

Alternativ kann der Kolmogorov-Smirnov-Test Anwendung finden. Hierfür müssen die (studentisierten) Residuen zunächst als neue Variable gespeichert werden. Im Dialogfeld „Lineare Regression“ steht hierfür die Schaltfläche „Speichern“ zur Verfügung. Anschliessend wird im Bereich „Residuen“ nun „Studentisiert“ ausgewählt und mit „Weiter“ bestätigt.

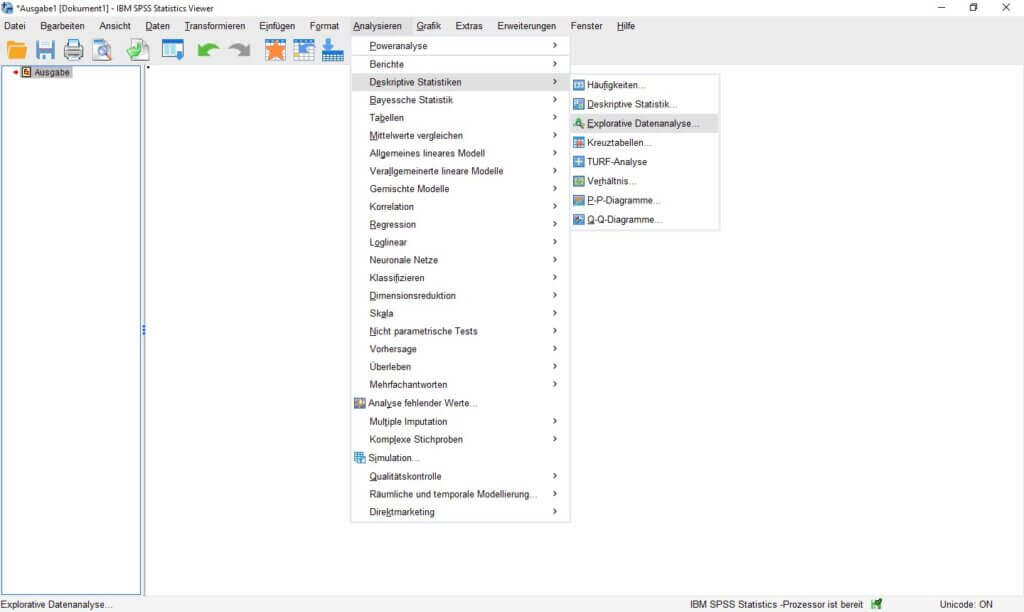

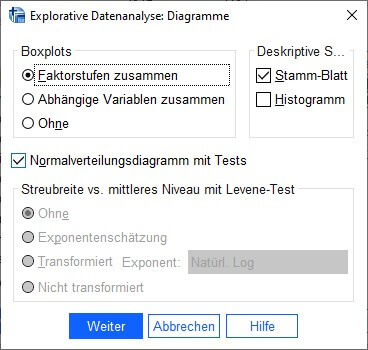

Die resultierende Variable wird dann im Zuge der „Explorativen Datenanalyse“ untersucht, die sich unter „Analysieren“ und anschliessend „Deskriptive Statistik“ findet. Hier wird die Schaltfläche „Diagramme“ ausgewählt und dann das Häkchen „Normalverteilungsdiagramm mit Tests“ aktiviert.

Im vorliegenden Fall zeigt sich, dass sowohl Kolmogorov-Smirnov- als auch Shapiro-Wilk-Test nicht signifikant sind. Beide Tests sprechen somit für die Annahme der Normalverteilung der Residuen. Fallen die Tests signifikant aus (p < 0,05), so sind Zweifel an dieser Annahme gerechtfertigt.

|

Test auf Normalverteilung

|

|

Kolmogorov-Smirnova |

Shapiro-Wilk |

| Studentized Residual |

Statistik |

df |

Signifikanz |

Statistik |

df |

Signifikanz |

| Studentized Residual |

0,126 |

25 |

,200* |

0,947 |

24 |

0,213 |

*. Dies ist eine untere Grenze der echten Signifikanz

a. Signifikanzkorrektur nach Lilliefors

Das Speichern der studentisierten Residuen über die Syntax erfolgt über die zusätzliche Befehlszeile „ /SAVE SRESID“. Die anschliessende explorative Analyse inkl. Test auf Normalverteilung der standardmässig benannten Residuenvariable „SRE_1“ wird mit den auf „EXAMINE VARIABLES=SRE_1“ folgenden Befehlen ausgelöst.

REGRESSION

/MISSING LISTWISE

/STATISTICS COEFF OUTS R ANOVA

/CRITERIA=PIN(.05) POUT(.10)

/NOORIGIN

/DEPENDENT wahlbeteiligung

/METHOD=ENTER sterblichkeit bildungsniveau urbanisation bip wahlpflicht

/SAVE SRESID.

EXAMINE VARIABLES=SRE_1

/PLOT BOXPLOT STEMLEAF NPPLOT

/COMPARE GROUPS

/STATISTICS DESCRIPTIVES

/CINTERVAL 95

/MISSING LISTWISE

/NOTOTAL.

Unabhängigkeit der Residuen

Zudem sollte das Regressionsmodell die Bedingung erfüllen, dass die Residuen untereinander keine Korrelation aufweisen, d. h. unabhängig sind. In diesem Fall läge eine zu vermeidende Autokorrelation vor. Im Regelfall tritt dieses Problem nicht auf, da meist Querschnittsdaten analysiert werden. Bei Längsschnittanalysen oder bei räumlicher Klumpung in Querschnittsdaten ist man dagegen häufiger mit der Autokorrelation konfrontiert. Will man das Modell dennoch auf Autokorrelation testen, so steht als statistischer Test die Durbin-Watson-Statistik zur Verfügung.

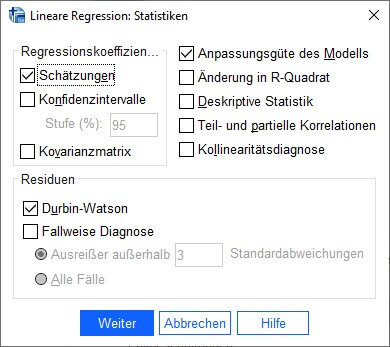

Der Test wird über die Schaltfläche „Statistiken“ im Dialogfeld „Lineare Regression“ erreicht. Im folgenden Dialogfeld wird das Kästchen bei „Durbin-Watson“ aktiviert.

Die Tabelle der Modellzusammenfassung wird nun um die Spalte „Durbin-Watson-Statistik“ ergänzt. Der Wertebereich der Statistik liegt in der Regel im Bereich 0 bis 4. Ist der Wert > 3, so muss eine Autokorrelation der Residuen angenommen werden. Im vorliegenden Fall beträgt der Wert etwa 2, sodass die Modellannahme erfüllt ist. Der Test ist allerdings nur dann anwendbar, wenn die Fälle im Datensatz sinnvoll sortiert sind, bspw. nach einer zeitlichen Abfolge im Falle von Längsschnittdaten. Bei einem Querschnittsdatensatz ist dies normalerweise nicht der Fall. Eine grafische Untersuchung von Autokorrelation ist daher ggf. vorzuziehen.

|

Modellzusammenfassungb

|

| Modell |

R |

R-Quadrat |

Korrigiertes R-Quadrat |

Standardfehler des Schätzers |

Durbin-Watson-Statistik |

| 1 |

,839a |

0,703 |

0,625 |

7,69729 |

2,059 |

a. Einflussvariablen: (Konstante), Wahlpflicht, Bruttoinlandsprodukt, Bildungsniveau, Urbanisationsgrad, Kindersterblichkeit

b. Abhängige Variable: Wahlbeteiligung

Die Syntax zur Generierung einer linearen Regression wird für die Durbin-Watson-Statistik um die Zeile „ /RESIDUALS DURBIN“ ergänzt:

REGRESSION

/MISSING LISTWISE

/STATISTICS COEFF OUTS R ANOVA

/CRITERIA=PIN(.05) POUT(.10)

/NOORIGIN

/DEPENDENT wahlbeteiligung

/METHOD=ENTER sterblichkeit bildungsniveau urbanisation bip wahlpflicht

/RESIDUALS DURBIN.

Keine Korrelation von Residuen und X-Variablen

Schliesslich gehört ebenfalls zu den relevantesten Annahmen, dass Residuen und X-Variable keine Korrelation aufweisen. Liegt hier eine Korrelation vor, geht diese vermutlich auf den Zusammenhang zwischen einer unbeobachteten unabhängigen Variable zurück, die für die Erklärung der abhängigen Variable relevant ist und zugleich mit der bereits berücksichtigten X-Variable korreliert. Auch diese Annahme lässt sich also über eine theoretisch fundierte Modellspezifikation sicherstellen. Will man die Annahme dennoch überprüfen, ist dies mithilfe bivariater Zusammenhangsanalysen möglich.